推特在容忍网络欺凌方面恶名昭著,纵容阴暗下流的厌女言论。数千名网络志愿者正在帮我们建立一套算法,自动识别网络欺凌行为。现在,你可以参与我们英文网站的行动,打击推特上的欺凌言论。

警告:文中包含粗言秽语,种族主义和性别歧视语言的屏幕截图

文/国际特赦组织资深创新倡导员米莱娜·马林(Milena Marin)

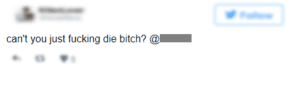

你认为这条推文是辱骂性言论吗?

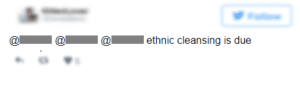

这条呢?

这是许多女性在推特(Twitter)上每天都会面对的欺凌行为。尽管上述推文明显违反了推特自身的仇恨行为政策 ,但这些推文仍在网上。该政策禁止“未经双方同意的种族比喻”及“暴力威胁”等行为。

女性显然不能依靠推特来识别和应对欺凌行为,这也是国际特赦组织设计这一网上众包项目的原因,让任何拥有手机或电脑的人都有反击的机会。

用大数据监察推特

喷子巡逻队(Troll Patrol)是一个崭新的平台,让互联网用户发挥作用,使推特变得更安全和更健康。国际特赦组织的喷子巡逻队整合了全球网络志愿者的力量,将“机器学习”和“众包”相结合,以应对人权侵害行为。

我们搜集了在2017年里数以十万计向女性政治家和记者发送的推文,当中的一些可能具有威胁性或辱骂性,而其他一些则是无害的。我们让志愿者帮我们整理这些推文,标记出那些辱骂性或有问题的。拥有足够的数据后,便能运用机器学习自动识别辱骂性的推文。

自计划4月启动以来,全球有逾5千志愿这参与喷子巡逻队项目。

志愿者可以花少至30秒的时间阅读一条推文后告诉我们它是否包含有问题或辱骂性内容,然后对辱骂内容进行分类,例如,该推文包含的是性别歧视抑还是恐同的内容?是否包含性或人身方面的威胁?

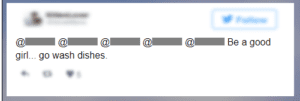

我们明白这并非非黑即白的问题,并非人人都对辱骂行为具有相同的界定或体验,有时,即使是本身看似并不算太糟糕的内容也有可能在反复发送的情况下造成伤害,例如下面这条推文:

就这样,我们对所有收到的资料进行核查并把它们与数以千计其他人所做的分类整合在一起,结果会得出一个巨大的数据库,其中包含针对女性的辱骂性推文的范例,有助于我们追踪并深入了解网络欺凌的模式。国际特赦组织的创新人员通过利用前沿机器学习科技,最终将能得出可以自动识别辱骂性推文的运算法则。

一旦我们可以自动识别这类信息,我们便能轻松应对,例如:谁接收了网络欺凌信息?谁是加害者?而最为关键的是推特在防止这些信息方面还能做些什么。

“众包”人权监察

其他社交媒体平台也在利用机器学习打击网络欺凌,但喷子巡逻队的独特之处,在于它令社交媒体用户参与其中,以寻获解决之道。

国际特赦组织过去曾利用类似的平台分析有关尼日尔三角洲的石油泄露问题,揭示出石油公司对这一问题的严重疏忽。我们通过把研究众包,大大减低我们研究员需用的时间,能建立起重要的证据,且毋需牺牲人为判断。

喷子巡逻队并非对推特实施监管或强迫其删除内容,我们要求推特更加透明,并希望通过将喷子巡逻队获取的数据呈现到其面前,迫使其做出改变。推特用户对问题的严重程度了解得越多,在曝光欺凌行为时就会感到更有信心。

倘若志愿者们能够系统性地识别网络欺凌行为,推特公司也应当如是。该公司在上月对我们的研究进行回应时表示:“无法解决社会上存在的仇恨与偏见”。我们并未对其提出这一要求,而是要求该公司通过不再放任自身平台上的欺凌现象,停止令仇恨继续滋生。

想帮忙打击网络攻击吗?每一个能上网及拥有手机、平板电脑或电脑的人都可以参与喷子巡逻队:

https://decoders.amnesty.org/projects/troll-patrol

背景

上个月,国际特赦组织就女性向推特举报暴力及欺凌行为的经历发布了广泛研究。推特已经成了有名容忍厌女行为的网上平台。尽管推特公司被多次要求,但依然拒绝发布任何数据,交代其收到欺凌行为举报的数量、如何进行回应或如何培训审查人。此举隐瞒了问题的严重性,令人难以知晓可以如何改进目前对不少女性来说明显无什作用的举报系统。搜集数据是令推特公司对其未能保护网络人权承担责任的第一步,这也是你可以参与其中的环节。